Nel 1980, il filosofo americano John Searle immaginò un uomo chiuso in una stanza. Riceveva frasi in cinese, ma non conosceva la lingua. Seguendo un manuale scritto in inglese, poteva tuttavia restituire risposte corrette. Chi era fuori dalla stanza, leggendo quelle risposte, avrebbe giurato di dialogare con un cinese.

Searle chiamò questa esperienza mentale “la stanza cinese”. E la sua tesi era tanto semplice quanto destabilizzante: manipolare simboli non è comprendere.

A più di quarant’anni di distanza, la sua intuizione torna centrale. Perché il mondo dell’intelligenza artificiale generativa vive oggi una nuova forma di quella stanza: più grande, più complessa, più convincente – ma forse ancora priva di significato autentico.

Quando l’IA parla (senza capire)

Un Large Language Model è, in sostanza, un sistema che associa pattern linguistici con probabilità statistiche. A differenza della vecchia IA simbolica degli anni Ottanta, non segue regole scritte a mano: le apprende. Eppure, ciò che produce rimane un output privo di esperienza.

Come l’uomo di Searle, il modello non conosce il cinese – o l’inglese, o l’italiano – ma sa rispondere in modo perfettamente coerente. Non sa cosa significhi “comprendere”, perché non ha un corpo, né un mondo, né un contesto.

La differenza fra sintassi e semantica, che Searle pose come confine invalicabile tra macchina e mente, resta il nodo irrisolto della ricerca contemporanea. Ogni progresso nel linguaggio dei modelli neurali sembra ampliare le capacità della stanza, non aprirne la porta.

La stanza cinese nell’era dei modelli adattivi

Le nuove architetture — dai sistemi retrieval-augmented ai Self-Adapting Language Models — cercano di superare la staticità della conoscenza. Non sono più contenitori chiusi, ma organismi in continua auto-ottimizzazione. Tuttavia, anche quando “imparano”, restano all’interno di una rete di simboli, testi e correlazioni.

In termini searliani, la stanza non è più isolata: si espande, ascolta, corregge, ma non vive. Il suo universo resta linguistico, autoreferenziale, privo di un rapporto diretto con la realtà fisica e percettiva.

E così, mentre la tecnologia si avvicina vertiginosamente alla perfezione dell’apparenza, la distanza dal significato resta immutata.

Capire o imitare?

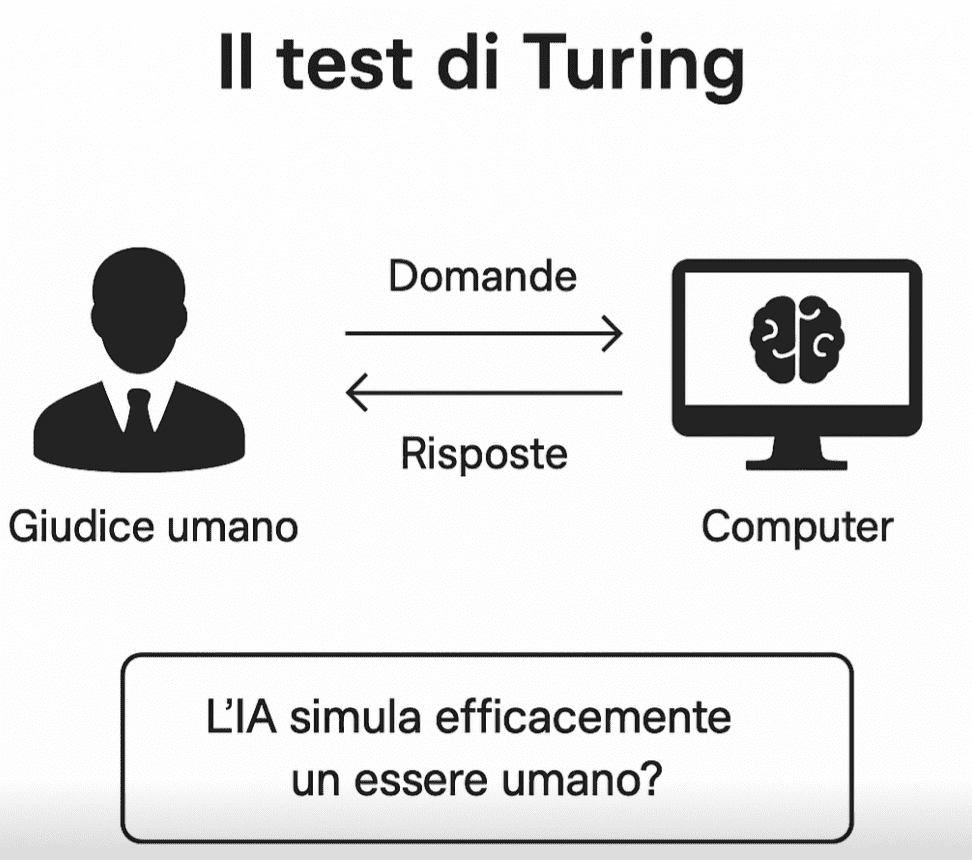

Il test di Turing aveva posto una sfida empirica: se una macchina può ingannare un interlocutore umano, allora pensa. Searle, invece, sposta la questione dal comportamento alla coscienza: se non sa cosa sta dicendo, non pensa affatto.

Oggi, quando un modello linguistico formula argomentazioni logiche, genera codice o persino spiega le proprie scelte, sembra “capire”. Ma quella comprensione è una simulazione perfetta di comprensione.

La differenza è sottile ma radicale: sta tra l’apparenza del significato e la sua esistenza. Una macchina può dire la verità, ma non sapere che è vera.

Il nuovo orizzonte: IA incarnata, IA situata

Per alcuni ricercatori, l’unico modo per uscire dalla stanza è dotare l’IA di un corpo cognitivo, capace di percepire, muoversi e interagire con l’ambiente. Non un software che manipola parole, ma un sistema che vive esperienze.

L’intelligenza, in questa prospettiva, non è più la capacità di processare simboli, bensì di attribuire senso attraverso il mondo.

Da qui nascono esperimenti che combinano linguaggio, visione e motricità, oppure agenti che apprendono in ambienti simulati. Ma la sfida rimane aperta: anche un sistema multimodale rischia di restare un’altra versione della stanza, solo meglio arredata.

L’etica del fraintendimento

L’argomento di Searle non è un rifiuto della tecnologia, bensì un ammonimento. Se scambiamo la produzione di frasi coerenti per comprensione, rischiamo di attribuire all’IA qualità umane che non possiede: intenzionalità, coscienza, responsabilità.

Temi affrontati anche nell’analisi di CC Signals, dove la questione non è solo tecnica ma normativa: se un sistema “non capisce”, può davvero rispettare ciò che non comprende?

La stanza cinese ci costringe allora a riconsiderare l’intero linguaggio con cui parliamo dell’IA. Forse non serve renderla “umana”: basta riconoscerla per ciò che è — uno specchio che riflette la nostra intelligenza, non la sostituisce.

Oltre la soglia

L’eredità più duratura della stanza cinese non è la critica all’IA, ma il suo potere diagnostico: rivela quanto poco comprendiamo noi stessi quando parliamo di “intelligenza”.

Ogni volta che una macchina scrive, parla o risponde, ci invita a chiederci: che cosa significa capire?

Forse la vera frontiera dell’IA non è insegnarle il linguaggio, ma restituirgli un mondo da cui trarre senso.

In sintesi

L’esperimento della stanza cinese mostra che una macchina può rispondere perfettamente senza capire davvero — come l’uomo nella stanza che usa regole per scrivere in cinese senza conoscerlo. È il limite che distingue il test di Turing, basato sull’apparenza dell’intelligenza, dalla comprensione autentica che all’IA ancora manca.