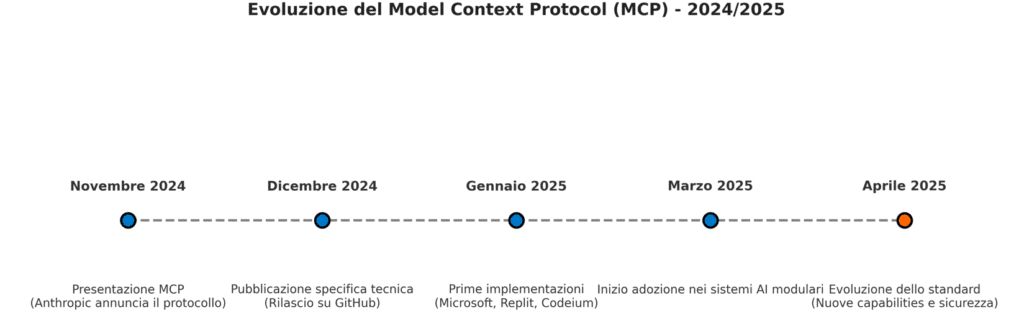

Nel novembre 2024, Anthropic ha presentato al pubblico il Model Context Protocol (MCP), una specifica pensata per risolvere uno dei limiti strutturali dell’intelligenza artificiale contemporanea: l’impossibilità per i modelli di linguaggio di interagire in modo standardizzato e sicuro con fonti di dati esterne.

A pochi mesi dal rilascio, ad aprile 2025, MCP si configura come uno degli sviluppi più promettenti per l’interoperabilità tra sistemi AI complessi.

Non si tratta di una semplice API o di un nuovo strumento di plugin: MCP ambisce a stabilire uno standard di comunicazione capace di collegare modelli, dati e strumenti in modo fluido, scalabile e sicuro.

La genesi di MCP: rispondere a un’esigenza sistemica

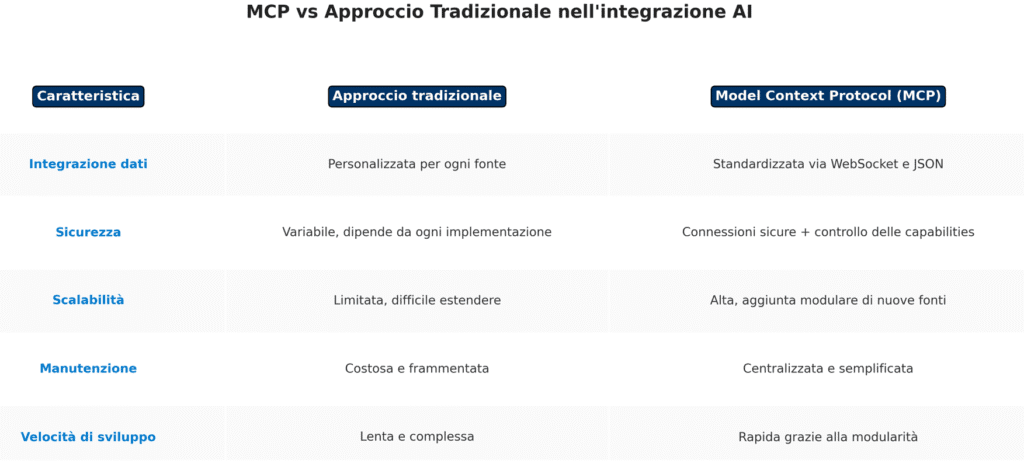

Finora, ogni applicazione basata su modelli di linguaggio ha dovuto implementare soluzioni proprietarie per accedere a basi dati, repository o servizi esterni.

Questo approccio ha frammentato il panorama AI, aumentando i costi di sviluppo e riducendo la portabilità delle soluzioni.

MCP nasce esattamente per superare questa frammentazione: offrendo un protocollo unico, basato su WebSocket sicuri e scambio di messaggi JSON, per permettere a un modello AI di interrogare, aggiornare o ricevere dati da fonti esterne senza dover essere “personalizzato” ogni volta.

La proposta di Anthropic si inserisce in un contesto di crescente interesse per la creazione di architetture AI modulari e multi-agente, in cui modelli diversi collaborano su compiti complessi.

Architettura tecnica: come funziona il Model Context Protocol

MCP è strutturato attorno a tre ruoli principali:

- Host MCP: l’entità (spesso un modello o un’applicazione AI) che richiede dati o operazioni esterne.

- Client MCP: il mediatore tecnico che gestisce le connessioni tra Host e Server, solitamente un software leggero o integrato nella piattaforma.

- Server MCP: il fornitore di capacità (capabilities), ovvero dati, servizi o funzionalità disponibili su richiesta.

La comunicazione avviene attraverso connessioni WebSocket persistenti, in cui l’Host invia richieste strutturate e riceve risposte contestuali.

Il protocollo è pensato per essere estendibile, con la possibilità di definire nuove capacità senza rompere la compatibilità retroattiva.

Creare un Server MCP: panoramica pratica

Per realizzare un Server MCP è necessario:

- Implementare il protocollo WebSocket secondo le specifiche ufficiali disponibili su GitHub.

- Esporre una o più capacità (“capabilities”) tramite API o metodi diretti.

- Gestire autenticazione e autorizzazioni per limitare l’accesso ai dati sensibili.

- Rispondere a richieste strutturate con payload JSON, mantenendo la compatibilità con lo schema MCP.

Le implementazioni attuali più rapide avvengono in linguaggi come Python (usando librerie come websockets o FastAPI) e Node.js (ws, express).

È già in corso la creazione di librerie MCP open-source che semplificheranno ulteriormente la creazione di server e client.

Applicazioni pratiche di MCP nel 2025

MCP, a meno di sei mesi dal rilascio, ha trovato applicazione in diversi settori:

- Assistenti AI evoluti: piattaforme che combinano chatbot con accesso a database CRM aziendali.

- Sviluppo software: editor di codice AI-first (come Replit) che integrano repository Git o documentazione tecnica.

- Sistemi HR automatizzati: agenti AI che analizzano dati da sistemi di tracciamento candidati (ATS).

- Knowledge management aziendale: soluzioni che consentono ricerche su documentazione interna tramite assistenti basati su AI.

Questi primi casi dimostrano come MCP renda possibile l’orchestrazione fluida di modelli e dati in scenari anche complessi e dinamici.

I limiti attuali di MCP

Nonostante il potenziale, MCP è ancora in fase iniziale:

- Standard in evoluzione: nuove capacità e specifiche sono ancora in fase di definizione.

- Sicurezza: benché il protocollo preveda connessioni sicure, non esistono ancora policy unificate per la gestione di dati sensibili tra Server diversi.

- Adozione limitata: al momento, MCP è implementato da una cerchia ristretta di attori tecnologici, e richiederà tempo per diventare uno standard diffuso.

La governance del protocollo sarà uno degli aspetti critici nei prossimi anni.

Leggi anche OpenAI o3, o4-mini e Codex CLI: la nuova frontiera dell’AI agentica

Conclusione

Il Model Context Protocol è un passo necessario verso un’intelligenza artificiale più modulare e cooperativa.

Pur trovandosi ancora in una fase embrionale, MCP potrebbe, se adottato su scala più ampia, trasformare il modo in cui i modelli AI interagiscono con il mondo esterno.

Standardizzare il dialogo tra intelligenze artificiali e fonti di dati è, forse, il vero fondamento della prossima generazione di sistemi autonomi.